Tips för att identifiera AI-skapade bilder

- Den här artikeln är mer än två år gammal.

- Publicerad 3 juli 2023 13:48

- Uppdaterad den 2 maj 2024 11:37

- Lästid: 9 minuter

- Juliette MANSOUR, AFP Frankrike

- Översättning och anpassning: Anna HOLLINGSWORTH

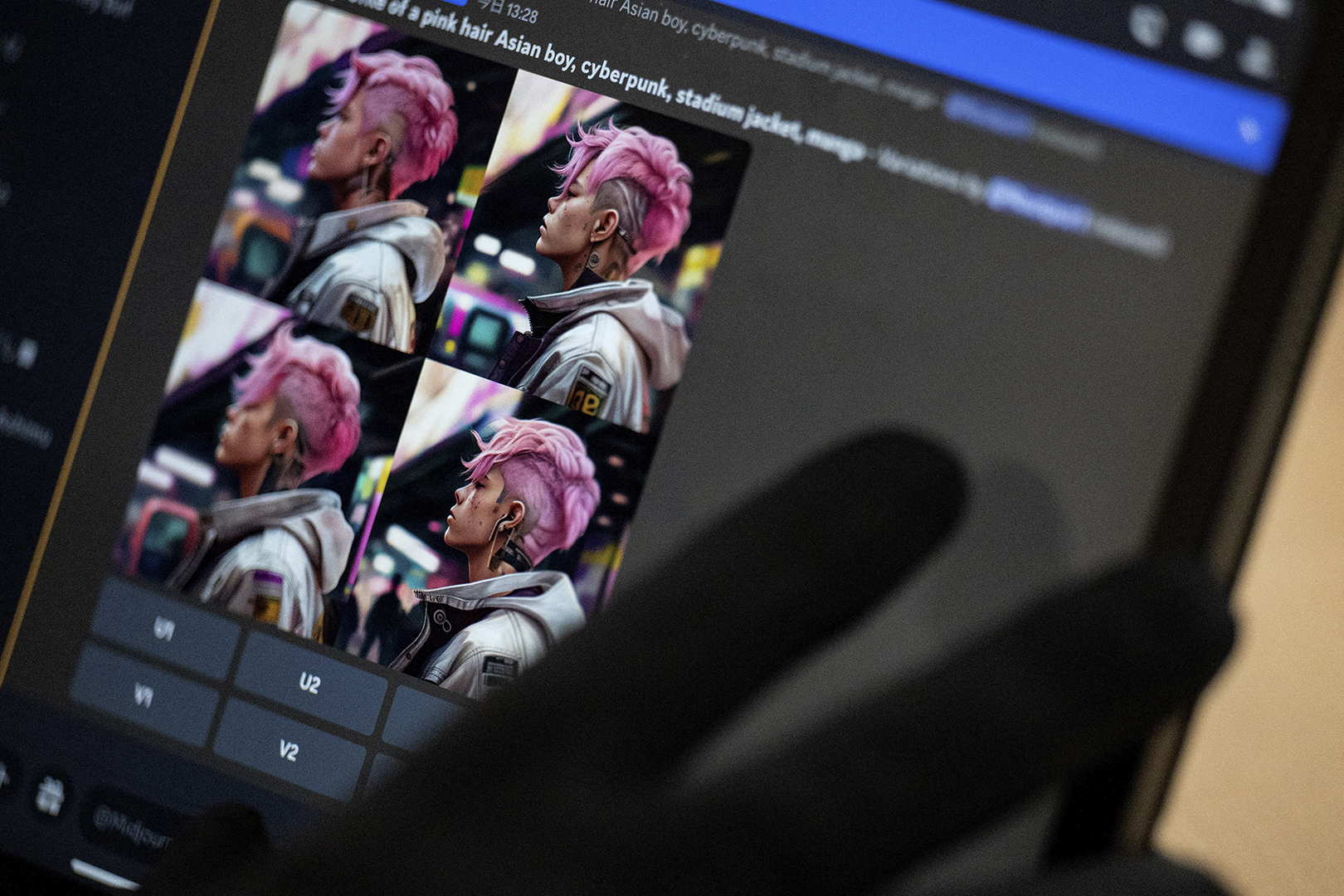

AI-verktygen Midjourney, DALL-E, Craiyon och Stable Diffusion kan skapa en gränslös mängd bilder utifrån enorma databaser.

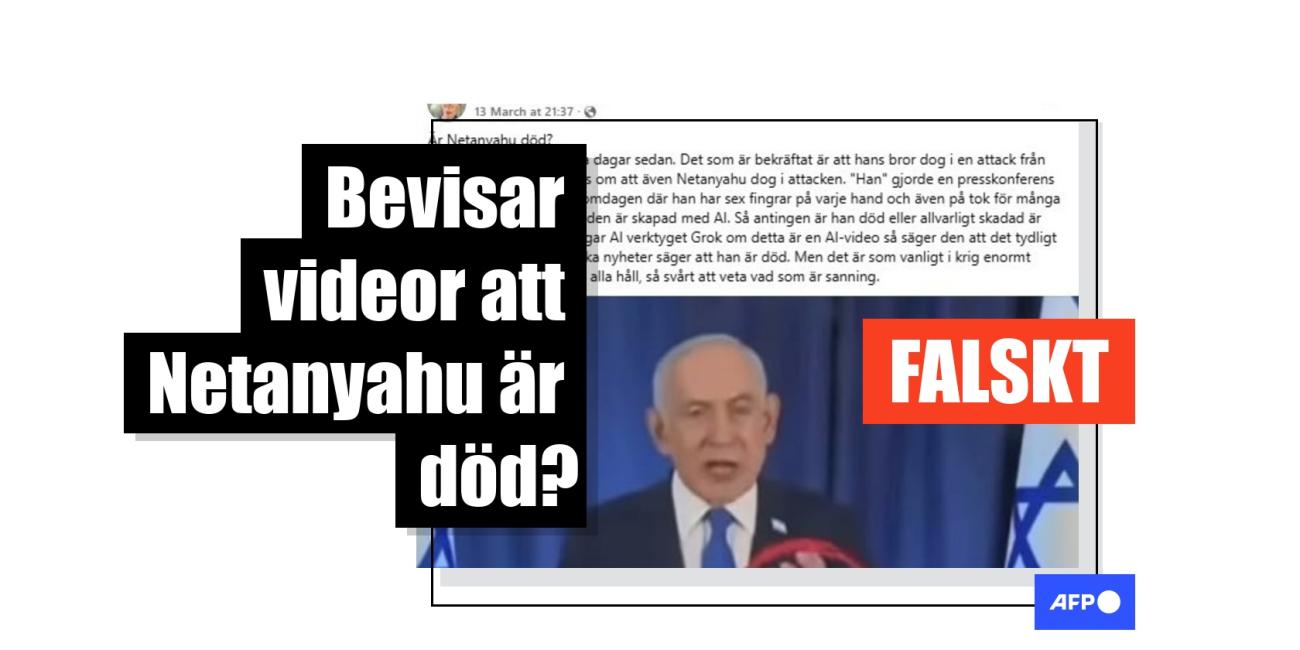

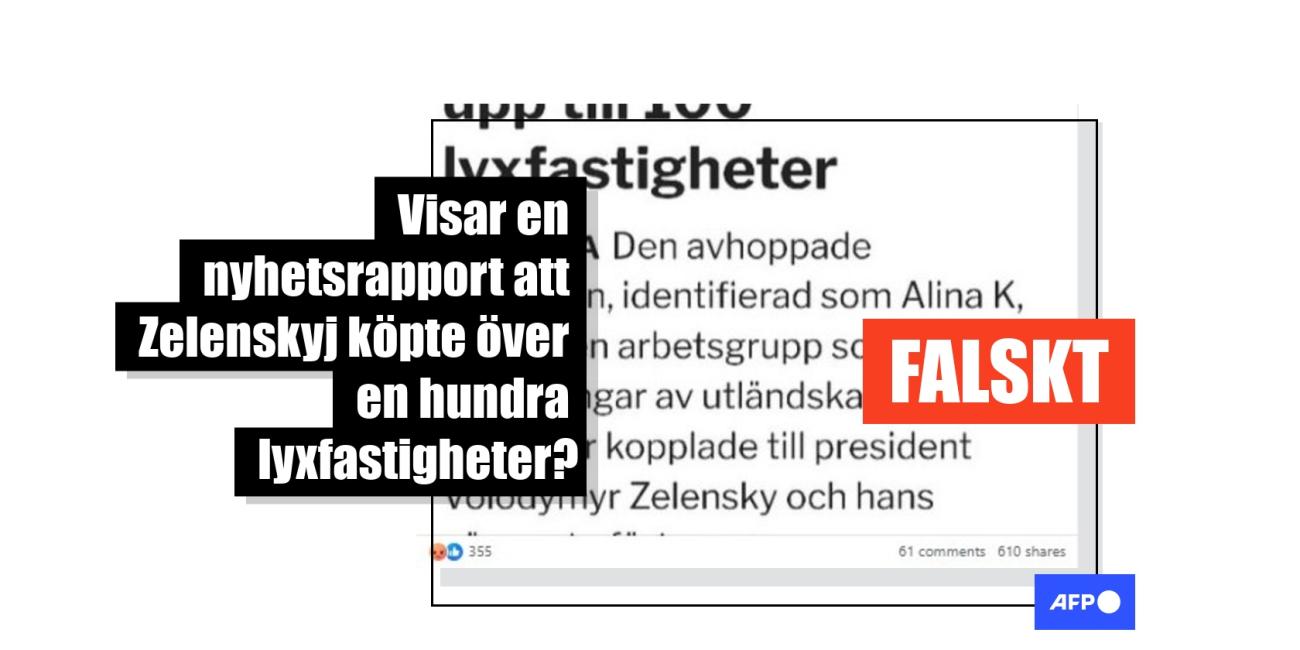

Många använder dem i humoristiska eller konstnärliga syften men i vissa fall genereras bilder som föreställer politiker eller som har med andra nyheter att göra. Svenska medier har rapporterad om flera sådana fall, t.ex. fallet om en avliden skådespelare eller fejkbilden på en Pentagon-explosion som orsakade börskaos.

Efter mötet mellan Putin och Xi den 20 mars 2023 delades flera AI-skapade bilder på Twitter där Putin knäböjde framför Xi. Och när soporna svämmade över på gatorna i Paris under strejken mot en ny pensionsreform spreds bilder på Frankrikes president Emmanuel Macron som sophämtare.

Även om de flesta upphovsmän gör tydligt att bilderna inte är äkta sprids vissa bilder ur sitt sammanhang och presenteras som äkta.

Det finns verktyg för att identifiera dessa bilder, såsom Hugging Face, men resultaten är blandade och även missvisande i vissa fall, enligt tester som AFP genomfört.

Hi, I'm a tech reporter that covers China, cybersecurity, & new media. Hundreds of people are sharing this photo of Xi Jinping & Vladimir Putin as they meet at the Kremlin. The two did meet, but it's highly likely this photo was generated by an AI program. Here's why: pic.twitter.com/6xqsDLxiMa

— Amanda Florian 小爱 (@Amanda_Florian) March 21, 2023

L'#ia#photo a fait des progrès démentiels en très peu de temps, désormais le #fake sera la norme sur les #reseaux, doutez de ce que vous voyez par défaut, plus le choix.#midjourney#midjourneyv5pic.twitter.com/dJoZXGrbRy

— Cryptonoo₿ From 100K to 0 (@Cryptonoobzzzz) March 19, 2023

— När en AI skapar bilder (från grunden) har den vanligen inte en viss originell bild som den tar delar från, berättade AI-experten och ingenjören David Fischinger från Österrikes teknologiska institut för AFP den 21 mars.

— Det finns tusentals/miljontals foton som har använts och miljarder parametrar har matats in.

Vincent Terrasi är en av grundarna till Draft & Goal, en startup som har utvecklat ett verktyg för universiteten ämnat att identifiera AI-skapade bilder.

— AI kombinerar dessa bilder som finns i dess databas, tar isär dem och bygger sedan om bilden pixel för pixel, vilket innebär att man inte längre kan märka skillnaderna på originalbilderna i slutprodukten, sade han.

Därför fungerar program som har utvecklats för att identifiera manipulationer dåligt eller inte alls. Bildens metadata kan ibland avslöja källan av en AI-genererad bild men även det är inte alltid till hjälp.

— Tyvärr kan man inte lita på metadata eftersom det tas bort i sociala medier, sade AI-experten och professorn Annalisa Verdoliva vid Frederik II universitet i Neapels.

Leta efter källan till bilden

Enligt experterna är ett tips att ta reda på när bilden publicerades på nätet. I vissa fall säger bildens upphovsman att den skapades av AI och pekar på verktyget som använts.

Omvänd bildsökning kan vara till hjälp: då kan man se om en bild indexerats i sökmotorer och leta efter gamla inlägg där bilden visas.

På detta sätt kan man spåra var bilderna på Trump och poliser som ska ha gripit honom ursprungligen publicerades.

En omvänd bildsökning på Google med en av bilderna ger som resultat en tweet från Eliot Higgins, grundaren till Bellingcat-nätverket. Tweeten publicerades den 20 mars 2023.

Higgins förklarade i en Twitter-tråd att han skapade bilderna genom att använda den senaste versionen av Midjourney.

Making pictures of Trump getting arrested while waiting for Trump's arrest. pic.twitter.com/4D2QQfUpLZ

— Eliot Higgins (@EliotHiggins) March 20, 2023

Även om inte originalbilden hittas med omvänd bildsökning kan den visa upp en version av bilden med bättre kvalitet i det fall att den har beskärts eller redigerats när den spridits i sociala medier. Det är lättare att hitta fel på en bild med högre kvalitet. Dessa fel kan avslöja att bilden är AI-skapad.

Med en omvänd bildsökning kan också andra, liknande bilder hittas som kan vara till nytta när AI-skapade bilder jämförs med bilder från pålitliga källor.

T.ex. när det gäller bilden där Putin knäböjer framför Xi, märkte Twitter-användare, såsom den italienska journalisten David Puente, att rummet på en av bilderna var inrett på ett annat sätt än på bilderna i massmedier som rapporterade om mötet.

Bildtexter och kommentarer på nätet kan också vara till nytta för att identifiera AI-skapat innehåll eller stilen av en viss AI. T.ex. DALL-E är känt för sin hyperrealism och Midjourney för sina scener med kändisar.

Baserat på detta kan det vara möjligt att leta efter bilden inom verktyget som användes för att skapa den. Verktyg såsom Midjourney gör tillgänglig diskussioner mellan programmet och användare. På så sätt kan man få tillgång till vissa bilder som har genererats där.

Visuella ledtrådar

Hittas inte källan till bilden kan den analyseras genom att använda visuella ledtrådar som tyder på att den har skapats av AI.

Leta efter ett vattenmärke

Ibland är ledtrådarna svåra att identifiera, som vattenmärken.

T.ex. DALL-E lägger till automatiskt ett flerfärgat streck i det nedre högra hörnet på bilderna. Crayion har en liten röd penna på samma plats.

Alla bilder skapade av AI har dock inte ett vattenmärke och märket kan också tas bort, beskäras eller gömmas.

Ledtrådar från konstvärlden

Tina Nikoukhah forskar inom bildbehandling vid ENS Paris-Saclay universitet.

— Om du har tvivel, titta på kornigheten på bilden som är mycket annorlunda på en AI-genererad bild än på ett riktigt foto, berättade hon för AFP.

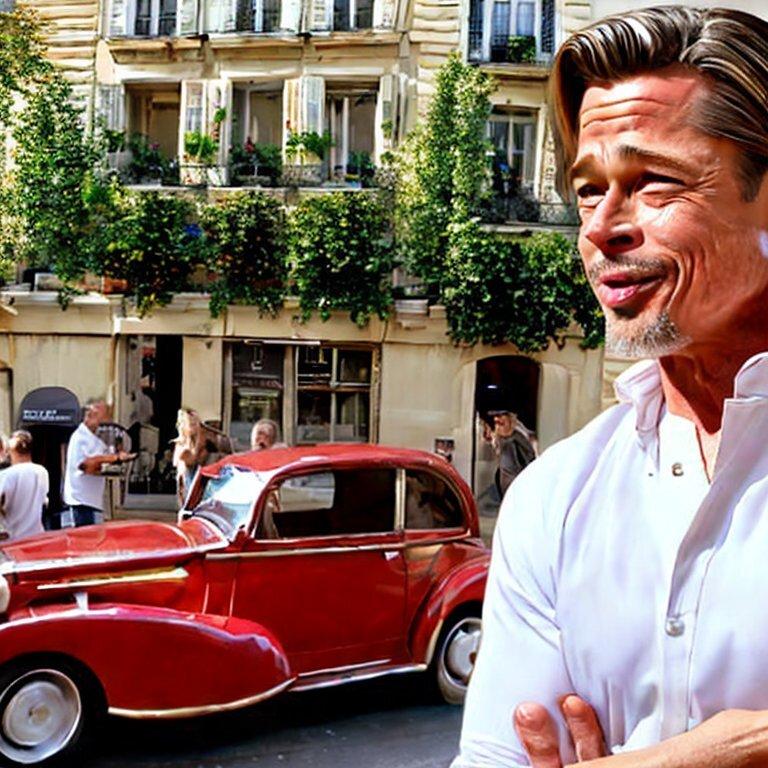

AFP använde de fria versionerna av AI-verktyg för att producera hyperrealistiska bilder av Brad Pitt i Paris.

Exemplet till höger skapades genom att använda en liknande beskrivning med DALL-E. Denna bild är mindre tydligt AI-skapad.

Visuella inkonsekvenser

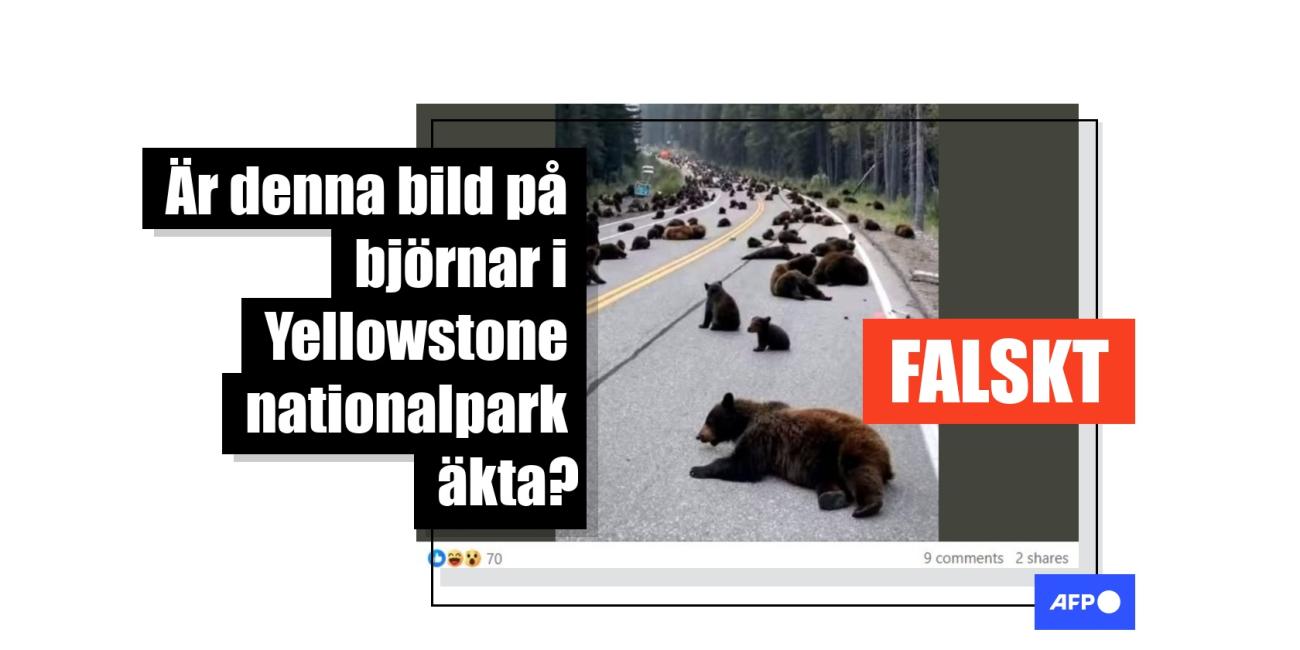

Även om generativ AI har förbättrats betydligt finns det ännu fel i innehållet den skapar. Enligt experter är dessa fel det bästa sättet att identifiera en AI-bild.

— Vissa egenskaper, ofta desamma, är ett problem för artificiell intelligens. Man bör granska precis dessa inkonsekvenser och artefakter såsom i ett hitta skillnader-spel, sade Terrasi.

Verdoliva påpekar att det är ett område i ständig förändring och att man bör vara försiktig.

— Produktionsmetoderna förbättras hela tiden och visar allt färre konstgjorda artefakter så jag skulle inte lita på visuella ledtrådar på lång sikt.

I mars 2023 var det svårt att skapa t.ex. realistiska händer. På den AI-skapade bilden om Pitt ovan till vänster har skådespelaren ett oproportionerligt stort finger.

I februari 2023 påpekade en AFP-journalist på Twitter att polisen hade sex fingrar på foton som påstods komma från demonstrationerna mot planer på en ny pensionsreform i Frankrike den 7 februari 2023.

The hand strikes again: these photos allegedly shot at a French protest rally yesterday look almost real - if it weren't for the officer's six-fingered glove #disinformation#AIpic.twitter.com/qzi6DxMdOx

— Nina Lamparski (@ninaism) February 8, 2023

— För närvarande är det också mycket svårt för artificiell intelligens att skapa reflektioner, sade Terrasi.

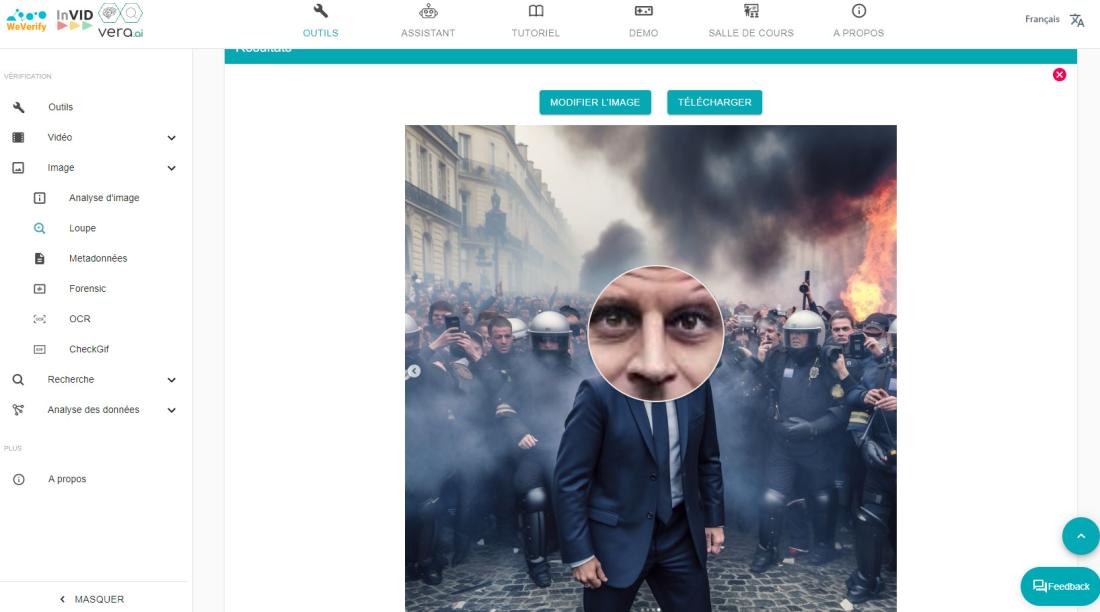

— Ett bra sätt för att identifiera artificiell intelligens är att leta efter skuggor, speglar, vatten men också att zooma in på ögonen och granska pupillerna eftersom det vanligen finns en reflektion när man tar ett foto. Ofta kan vi märka också att ögonen är olika stora och ibland har de olika färger.

Nedan visas hur förstoringsverktyget på Invid/WeVerify avslöjar att Macrons ögon har olika färger på en bild som skapades av AI och delades på Instagram. Ögonen på bilden har två olika nyanser av brunt men i verkligheten är Macrons ögon blåa.

Det finns ofta också asymetrier på AI-skapade bilder. Ansiktena kan vara oproportionerliga och öronen olika stora.

Det är svårt att återskapa tänder och hår och deras konturer och textur kan avslöja att bilden inte är äkta

Dessutom är det svårt att integrera vissa element i bilden, såsom solglasögon som smälter in i ansiktet.

Enligt experter kan blandning av flera foto leda till problem med exponering i AI-skapade bilder.

Kolla bakgrunden

Ett bra sätt att upptäcka inkonsekvenser är att granska bildens bakgrund. Även om bakgrunden skulle se normal ut vid första anblick, finns det ofta fel i AI-skapade bilder, såsom i dessa bilder där Barack Obama och Angela Merkel ska vara på stranden.

Som bilden nedan visar verkar benen av en av personerna i bakgrunden vara brutna på mitten:

— Ju längre bort ett element befinner sig, desto mer blir objektet suddigt, förvrängt och får ett felaktigt perspektiv, sade Terrasi.

I den AI-skapade bilden om mötet mellan Xi och Putin är en linje på en kolumn i bakgrunden inte rak. Putins huvud ser också oproportionerligt ut jämfört med resten av kroppen. Fischinger berättade för AFP att dessa inkonsekvenser avslöjar att det handlar om en AI-skapad bild.

Använd sunt förnuft

Även om vissa saker i bilder inte är förvrängda kan de avslöja logiska fel.

— Det är bra att lita på sunt förnuft, sade Fischinger i svåridentifierade fall.

I bilden nedan som AFP skapade med DALL-E och som ska visa Paris kan man se en blå förbudsskylt som inte finns i Frankrike.

Skylten tyder på att bilden är skapad med AI tillsammans med brutna fingertoppar, den plastliknande croissanten och skillnaderna i exponering i vissa fönster.

Vattenmärket i det nedre högra hörnet bekräftar att bilden har skapats med DALL-E.

Om en bild påstås visa en viss händelse men den verkar inte vara pålitlig bör man vända sig till pålitliga källor för att ta reda på eventuella inkonsekvenser.

Artikelns metadata har uppdaterats

2 maj 2024 Artikelns metadata har uppdaterats

Copyright © AFP 2017-2026. Kommersiell användning av innehållet kräver en prenumeration. Klicka här för mer information.

Finns det något du skulle vilja att AFP faktagranskade?

Kontakta oss